大語言模型(Large Language Models, LLMs)作為人工智能領域的重要突破,其發(fā)展歷程與計算機軟硬件技術的演進密不可分。從早期的統(tǒng)計語言模型到如今的千億參數規(guī)模,每一次技術飛躍都依賴于軟硬件的協(xié)同創(chuàng)新。

一、技術發(fā)展歷程

1. 早期探索階段(2010年代初期)

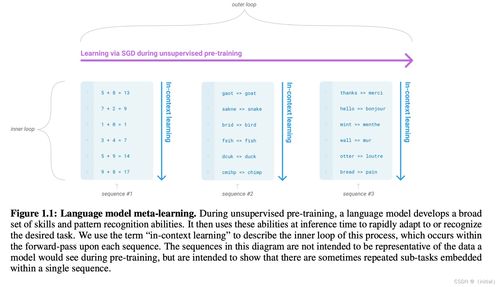

基于循環(huán)神經網絡(RNN)和長短期記憶網絡(LSTM)的早期語言模型開始出現。這一時期,模型規(guī)模相對較小,訓練數據有限,主要依賴CPU和少量GPU進行計算。硬件瓶頸限制了模型規(guī)模的擴展,但為后續(xù)發(fā)展奠定了基礎。

2. 轉型突破階段(2017-2020年)

Transformer架構的提出徹底改變了語言模型的格局。注意力機制使得模型能夠并行處理序列數據,顯著提高了訓練效率。與此GPU計算能力的快速提升(如NVIDIA V100、A100的推出)使得訓練更大規(guī)模的模型成為可能。BERT、GPT-2等模型的成功,標志著大語言模型時代的開啟。

3. 規(guī)模化發(fā)展階段(2020年至今)

隨著GPT-3、PaLM等千億參數模型的涌現,大語言模型進入了規(guī)模化發(fā)展新階段。這一時期的顯著特點是:

- 模型參數呈指數級增長

- 訓練數據規(guī)模達到TB級別

- 硬件架構專門化(如TPU、AI加速芯片)

- 分布式訓練技術日益成熟

二、硬件技術的關鍵作用

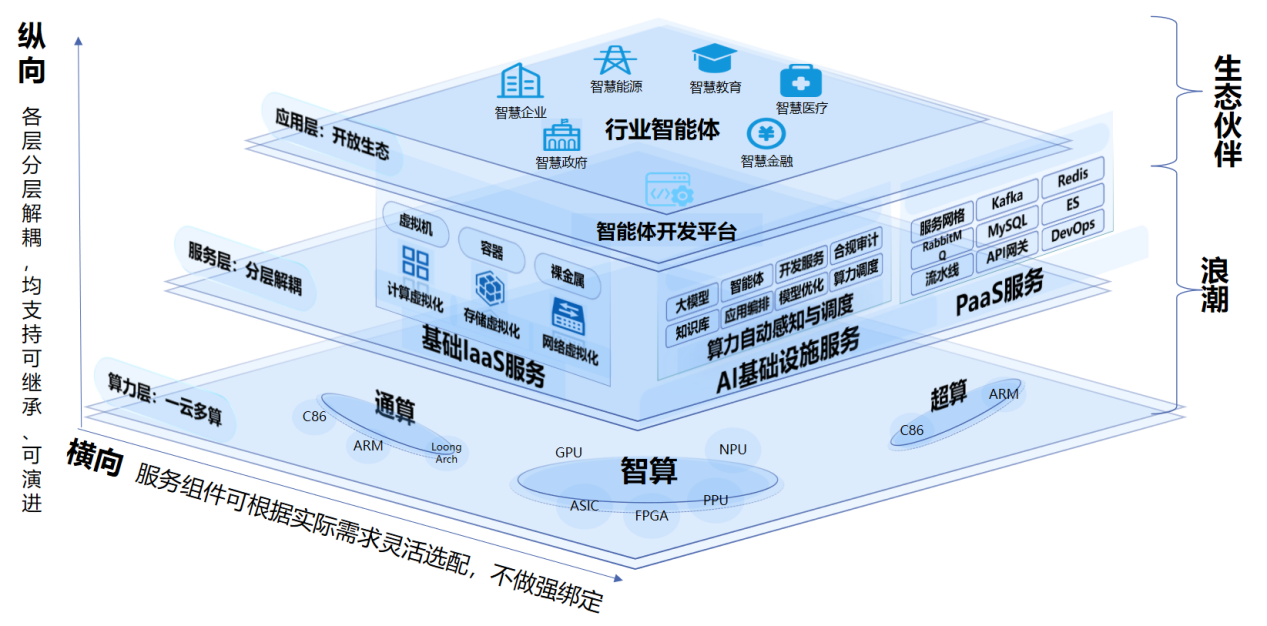

1. 計算芯片的演進

從通用GPU到專用AI芯片(如TPU、華為昇騰等),計算硬件的專門化大幅提升了訓練效率。內存帶寬的增加和計算精度的優(yōu)化(混合精度訓練)使得訓練超大規(guī)模模型成為可能。

2. 存儲系統(tǒng)的革新

高速NVMe SSD和大容量分布式存儲系統(tǒng)解決了海量訓練數據的I/O瓶頸。模型參數存儲和快速加載技術,確保了訓練過程的連續(xù)性。

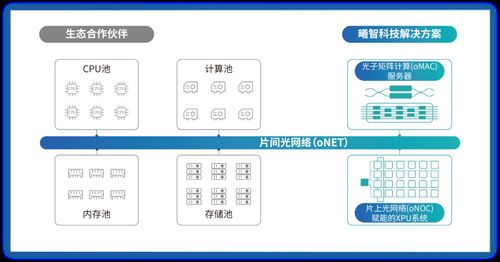

3. 網絡架構的優(yōu)化

InfiniBand、RoCE等高速網絡技術的應用,顯著提升了分布式訓練中節(jié)點間的通信效率,降低了同步開銷。

三、軟件技術的創(chuàng)新突破

1. 框架與工具的完善

TensorFlow、PyTorch等深度學習框架不斷優(yōu)化,提供了更加高效的分布式訓練支持。Megatron-LM、DeepSpeed等專門化訓練框架的出現,進一步降低了大規(guī)模模型訓練的技術門檻。

2. 算法優(yōu)化

模型并行、流水線并行、數據并行等分布式訓練策略的創(chuàng)新,有效解決了超大模型的內存和計算瓶頸。模型壓縮、知識蒸餾等技術,在保持性能的同時降低了部署成本。

3. 開發(fā)環(huán)境的演進

容器化技術(Docker)、集群管理工具(Kubernetes)的普及,使得大規(guī)模AI訓練任務的調度和管理更加高效。MLOps理念的推廣,提升了模型開發(fā)、部署和維護的全流程效率。

四、未來發(fā)展趨勢

1. 軟硬件協(xié)同設計

定制化AI芯片與算法框架的深度結合,將進一步提升計算效率。存算一體、近內存計算等新型架構可能成為下一代AI硬件的重要方向。

2. 能效優(yōu)化

隨著模型規(guī)模持續(xù)擴大,能耗問題日益突出。稀疏計算、動態(tài)推理等節(jié)能技術將成為研究重點。

3. 多模態(tài)融合

大語言模型正從純文本處理向視覺、語音等多模態(tài)方向發(fā)展,這對計算架構提出了新的挑戰(zhàn)。

4. 邊緣計算部署

模型輕量化技術的進步,將使大語言模型能夠在移動設備和邊緣設備上運行,拓展應用場景。

五、挑戰(zhàn)與思考

1. 技術門檻與經濟成本

超大模型訓練需要巨額資金投入,如何降低技術門檻和成本,讓更多研究機構和企業(yè)能夠參與創(chuàng)新,是行業(yè)面臨的重要問題。

2. 可持續(xù)發(fā)展

AI計算的巨大能耗與碳足跡問題亟待解決,綠色AI將成為未來發(fā)展的重要考量。

3. 安全與倫理

隨著模型能力的增強,內容安全、隱私保護、算法偏見等問題日益突出,需要建立完善的技術規(guī)范和治理框架。

大語言模型的發(fā)展是計算機軟硬件技術協(xié)同創(chuàng)新的典范。隨著芯片制程逼近物理極限,架構創(chuàng)新和算法優(yōu)化將變得更加重要。只有軟硬件深度協(xié)同,才能推動大語言模型技術向著更高效、更智能、更普惠的方向發(fā)展,最終實現人工智能技術的全面突破與廣泛應用。